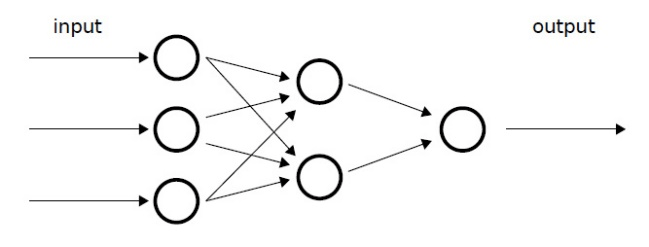

Een (artificieel) neuraal netwerk is een rekenmodel dat de werking van hersenen nadoet. Een netwerk bestaat uit knopen, de neuronen, die met elkaar zijn verbonden. Door samen te werken wordt een berekening uitgevoerd. Het netwerk kan worden getraind door middel van voorbeelden en feedback. Zo wordt het model steeds ‘slimmer’ [1]. Hieronder staat een voorbeeld van een neuraal netwerk.

Zo is het mogelijk om een netwerk te maken dat berekend hoe zoet een gerecht gaat wezen aan de hand van de ingrediënten. De neuronen kijken ieder naar de ingrediënten en geven er een score aan. Aan het einde worden deze scores samengevoegd tot een eindscore die de zoetheid van het gerecht weergeeft [1].

Zodra er een antwoord is berekend, wordt deze gecontroleerd en krijgt het netwerk feedback. Zo leert het model van fouten en worden berekeningen betrouwbaarder [1].

Maar wat gebeurd er op het moment dat één voorspelling meerdere keren wordt uitgevoerd? Welke impact heeft dit op de betrouwbaarheid van het netwerk? Deze vragen zullen hier worden beantwoord.

Vooroordelen en Leermaten

Belangrijke begrippen voor neurale netwerken zijn ‘vooroordelen’, ‘variatie’, ‘variantie’, ‘bovenmaats’ en ‘ondermaats’. Deze termen worden gebruikt om de wijze waarop een netwerk berekeningen doet te verwoorden [2].

Een netwerk ontwikkelt vooroordelen op het moment dat voorbeelden te eenzijdig zijn. Stel dat het netwerk voor het bepalen van de zoetheid van gerechten enkel zou zijn getraind met informatie over slagroom, suiker en aardbeien. Op het moment dat dit model een zure citroen tegenkomt, zal deze worden gelabeld als zoet, dat is namelijk het enige dat het model kent. Dit heet ondermaats trainen [2, 3].

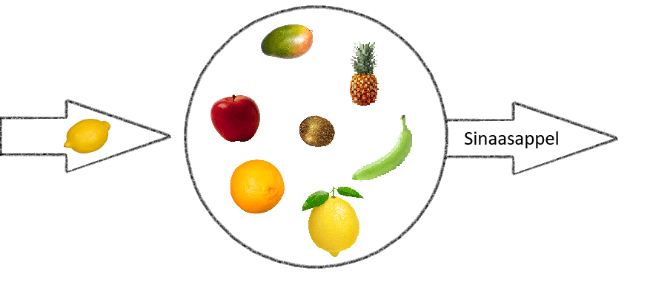

De afbeelding hieronder toont het herkennen van fruit door een ondermaats getraind netwerk. Er wordt gevraagd om een citroen te herkennen, maar het model kent alleen appels. Met de beschikbare kennis, geeft het netwerk als antwoord ‘Appel’.

De voorbeelden kunnen ook te breed zijn, bijvoorbeeld als alle mogelijke smaken éénmaal voorkomen in het model. Door de hoge variantie kunnen patronen niet herkend worden. Het model weet het effect niet van ketchup en chili, tegenover ketchup en citroensap. Dit tekort aan variatie heet overmaats trainen [2, 3].

In de bovenstaande afbeelding wordt opnieuw geprobeerd om een citroen te herkennen, dit keer met een overmaats getraind model. Vanwege de grote variantie in verschillende soorten fruit, maar de lage variatie in voorbeelden van een citroen, kan het model fouten maken. De citroen in het model heeft blaadjes, de sinaasappel niet. Gebaseerd op vorm zal dit model voorspellen dat er een sinaasappel wordt getoond.

Conclusie

Het uitvoeren van voorspellingen heeft invloed op de variatie en de variantie:

- Op het moment dat een voorspelling of voorbeeld meerdere keren door het netwerk gaat, stijgt de variatie binnen het model. Hierdoor wordt het model beter in het herkennen van een, bijvoorbeeld, een citroen.

- Als er veel verschillende voorspellingen worden gedaan, stijgt de variantie van het model. Zo kan er onderscheid worden gemaakt tussen verschillende dingen, bijvoorbeeld tussen een citroen en een appel.

De impact van het trainen op herhalende data is afhankelijk van de balans in variatie en variantie. Om een goed model te hebben dienen er voldoende voorbeelden te zijn van de verschillende mogelijke antwoorden.

Concluderend kan er gezegd worden dat het hebben van dubbele data in de trainingsdata niet slecht is, zolang er daarnaast ook genoeg variantie in de data aanwezig is.

Referenties

[1] L. L. Oosterhof, „Neurale Netwerken,” Rijksinpectie Digitale Infrastructuur, Groningen, 2023.

[2] ChatGPT, „Een Gids voor Neural Networks: Hoe ze Werken en Waarom ze Belangrijk Zijn,” ChatGPT in het Nederlands, 3 Februari 2025. [Online]. Available: https://chat-gpt-dutch.nl/neural-networks/. [Geopend 11 Maart 2025].

[3] GeeksForGeeks, „ML | Underfitting and Overfitting,” GeeksForGeeks, 27 Januari 2025. [Online]. Available: https://www.geeksforgeeks.org/underfitting-and-overfitting-in-machine-learning/. [Geopend 11 Maart 2025].

Plaats een reactie